私たちは日頃から、多くの複雑な音を扱っています。ゲームでは個別の音が、アウトプット全体のラウドネスに影響します。映画やテレビの制作と違い、どんなに小さなセグメントでもダイナミック性や周波性特性を私たちが自由に操ることはできません。複雑さゆえに、私も分かりやすく説明するのに大変苦労します。そこで、ここからの内容は、読者の皆さんのご意見を是非ともお聞きしたいところです!経験豊かなデザイナーであれば誰もが、自分なりの対策方法をもっているトピックで、個人的なやり方や、業界標準の手法などがあると思います。アセット数が10個や100個のときは余裕があっても、ゲームに出てくる何万個というアセットの周波数特性やラウドネスをバランスよく調整するのは、全く別の次元の問題になります。これが、大量生産と芸術制作の違いです。

アセットの周波数特性を制御する際はミックス全体が対象となり、音楽やダイアログを含め、どのようなアセットカテゴリーにも対応する必要があります。そこでこのプロセスの第一歩として、ほかの音のラウドネスや周波数特性のためのスペースを確保してあげることから始めます。ラウドネスコントロールの基本原則です。例えば楽曲の場合、マスターの周波数特性は発売用のレベルにして、フルダイナミックスにするべきです。一方、ゲームや映画に適用するバージョンは、ミックス内に充分な余裕が必要で、多くの場合、帯域全てを使ってはいけません。

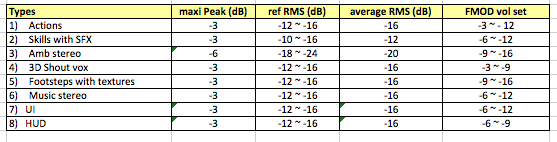

最近のコンソールゲームの領域で広く採用されているアセットのRMSラウドネス参照値を、以下に示します:

- 音楽:-16 dB

- アンビエンス:-16 dB

- ダイアログ: -12 dB

- ゲーム中のサウンドエフェクト(SFX): -16 dB

- UI: -16 dB

(これらは全てピーク値が -3 dB未満であり、±約2 dBの誤差が許容されます)

下の表で、アセットの通常ボリュームと、FMODのボリューム設定を紹介します(訳注: この記事のFMOD参照値は、すべて天涯明月刀(Moonlight Blade)のゲームで使用したFMOD Designerの特定バージョンを元にしています)。

このシステムの通常のワークフローを説明します:

1. ゲームのボリュームレファレンス値を決定します。ボリュームレファレンスとは、あるカテゴリーの音をミックス全体の最大ボリューム値に設定して、この参照(レファレンス)値以上のボリュームは、小数の音だけに、限定的に許容する、という考え方です。大抵の場合、レファレンス用のカテゴリーとして選ばれるのはダイアログです(叫び声は含みません)。音楽カテゴリーやUI音をボリュームのレファレンス値に採用するデザイナーもいます。プロジェクトのニーズに合わせて決めます。

2. 同じカテゴリーに属するアセットは、それぞれの再生方法や目的が異なっても、すべて前述のラウドネスレファレンスに近いRMSにします。つまりダイアログ以外のアセットはすべて、RMSを大体 -16 dBほどにします。

3ゲーム内では、サウンドの音量のバランスを保つために、SoundEventsとSoundCuesのボリュームやロールオフパラメータを微調整します。理由は、音同士のバランスを調整するときに、その音がうるさいのか、静かなのかを明確に判断できるようにするためです。

4. カラーレーションや周波数特性はプロジェクトの中盤から最終段階にかけて考慮されることが多く、その時点ですでにリソースの80%以上がゲームにインテグレートされています。様々なアセットの微調整やカラーレーションを始めるのは、ここからです。ここで注目するのは音の深さと周波数特性で、次にサウンドイベントのボリュームにも着目します。

基本的に、個別のアセットを比較的一貫したボリューム内に収め、アウトプット全体のラウドネスを論理ボリュームで制御して調整します。この従来型のバランス調整は、音楽業界、映画、テレビ業界などの長年のミキシングの流れをもとに構築されたもので、使われ続けているのには理由があります。この方式は静的なミキシングが中心で、ダイナミックミキシングの作用も多少あります。基本的にダイナミックミキシングを通じてバランスを保つ方式は主流ではなく、特にプロジェクトの初期から中盤にかけては、あまり採用されません。従来型アプローチの直接的なメリットは、制作過程のどの段階でも、アセットやイベントのボリュームを検討しているときに、基準となるボリューム数値が常に明示されていることです。もちろん、このアプローチは導入コストが高く、そこが欠点です。なぜなら、ミキシング経験の豊富なオーディオデザイナーが必要で、抜群の聴覚が要求されるからです。

実際、今のコンソール型ゲームでもこれが主流で、映画やテレビ業界のオーディオプロたちがゲーミング分野に移ってくるにつれ、さらに発展しています。今のオーディオエンジンは、サウンドデザイナーがこのような考え方を備えていることを前提としています。天涯明月刀(Moonlight Blade )プロジェクトは、興味深いケースです。プロジェクトを担当することになって、まず最初に何をしたかというと:

1. サウンドアセットの全カテゴリーを簡単に確認しました。私は時々、頭に目的を描きながらランダムにアセットを選んだりします。例えば、キャラクターのスキル(技)や基本的なボディー動作などに関連する音は1つのグループに、叫び声やダイアログは別グループ、コンバット音楽やBGMはさらに別グループにまとめます。それからグループごとに、まとめられたアセットのラウドネスの平均値や偏差値を求めます。

2. それぞれのサウンドカテゴリーのボリュームをFMODで設定する方法や、アセットボリュームに対してオーディオエンジンがランタイムに計算するボリュームの関係について、エンジンとアセットの両方のパラメータを変えながら実験して、自分の理解を深めます。おもしろいのは、どのオーディオエンジンをみても、同じエンジンの異なるバージョンでさえ、この領域での対応がそれぞれ違うことです!私はその微妙な差を見つけ出す作業で、本当に疲れ果ててしまいました(笑)。

要は、アセットのRMS、FMODのイベントボリューム、そしてゲーム内のボリュームのはっきりとした関係性を、明らかにしていきたいのです。このルールが、私のバランスの取り方や微調整の方法に影響します。

当時、このプロジェクトで発見したのは:

1. 2つあるミュージックの基本的なカテゴリーで、アセット間のラウドネスの違いは、大体10~12 dBでした。同じミュージックカテゴリー内のラウドネスの差は、平均10 dB。バックグランドミュージックのアセットの一部では、10 dB以上の差が発生することもありました(静かなパッセージ対クライマックスなどで)。

2. ダイアログのピークやRMSは割と安定していましたが、個別のレコーディングセッションは雑でした。マイクの配置、マイクの増幅、プリアンプ、声優とマイクの位置関係など、セッションごとに違っていました。ポストプロダクションの不適切な圧縮のため、重いルームリバーブが聞こえるダイアログがあったくらいです。キャラクターのスキルやアクションSFX(通常動作やスキル)をみると、RMSの違いは全体で約9 dBでした。スキルの特定のサウンドでは、高周波や低周波が通常より高いものもありました。

3. アンビエンスは、ミッドレンジが均等でなく、場合によっては低周波が多すぎました(再生テストした結果)。アンビエンスのボリュームや周波数特性は、ほとんど違いがありませんでしたが、お互いにうまくブレンドするには、さらに差を縮める必要がありました。

タイトなスケジュールだったので、いくつかの目標を念頭に、まず一括処理(私の作業の「第一波」)を最優先しました。

1. アセットのボリュームや深さや周波数特性を調整し、アセットが同じ収録、同じ基準で録られたように聞こえるようにしました。

2. 音質に磨きをかけ、とくにダイアログを改善しました。もとのアセットは、あまりにも味気ない感じでした。

3. 減衰は全てのアセットで16 kHz以上、60 Hz以下とし、サウンドカテゴリーによって減衰量や周波数帯をわずかに加減しました。

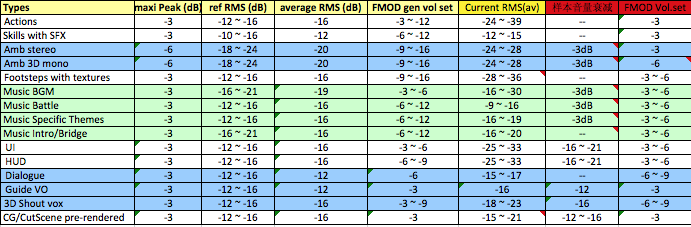

ただ、天涯明月刀(Moonlight Blade)独特の複雑な設定のため、簡単にはいきませんでした。リリーススケジュールのプレッシャーもあり、これらの手順を1つ1つこなすのは、どうも現実的ではありませんでした。一番のやり方は、現在のパイプラインを完全に理解し、そこから派生するボリューム処理のパターンも把握してから、すぐに実行できる安全なソリューションを見つけることでした。最終的なボリュームの構成は、このようになりました:

この表のように、アセットの現在のボリューム、それぞれのFMODのボリューム設定、そして目標とするボリューム値をまとめ、比較できるようにしました。比較は、メインリリースの初期の作業でも、リリース後のDLCの制作においても、大変役に立ちました。.

注:

1. アセットボリュームは絶対ボリュームではなく、大量のランダムサンプリングに基づく平均値を採用しています。

2. 目標ボリューム(Current RMS)が、最終的なインゲームのボリュームと異なることがあります。それでも通常の誤差は±3 dB以内です。

3.数値は全て、乱雑な生データそのものでなく、私が最初の処理として行ったアセットのRMS整理と周波数特性の調整(詳細は後述)のあとに取得した数値です。その結果、表中の差分が大きく、通常の作業内容と異なっていました。これは、天涯明月刀(Moonlight Blade)に採用したFMODのバージョンの3D減衰が、大きな問題を抱えていたからです。減衰の設定でEvent Vol = -6 dB としたとき、実際のゲーム中のボリューム減衰は -10 dBでした。減衰効果は、SoundMoodのコンフィギュレーションにも、大きく影響されました。

4. 一番右の列(FMOD Vol.Set)をみると、サウンドレイヤ同士の差は、大きくありません。実は、これは珍しいことです。通常、アセットボリュームのダイナミックレンジが狭ければ、FMODボリューム設定経由のダイナミック性がもっと大きいはずです。この主な理由は、多くのイベントでマルチレイヤ―が使われ、ランタイムのボリューム計算にカスタマイズされた曲線が多用されていたことです。もう1つの理由は、前述の3D減衰問題に関係します。

ボリュームレファレンス値は、コンソールゲームの通常のやり方ではなく、近道を採用しました。私のアプローチは完璧ではありませんが、天涯明月刀(Moonlight Blade)には、こちらの方が現実的でした。表中の列の色分けに注意すると、ボリュームのレイヤーが見えてきます。簡単に言うと、目的はカラーレーション、ダイナミック性、周波数特性などの観点から、各サウンドカテゴリーのレイヤーをはっきりと区別させることでした。

アセットに磨きをかける「第一波」の前に、次の2つのことを行いました。

1. 主にマップのミュージックやアンビエンスなどの共通のアセットを、通常のボリューム設定を使って小規模な範囲で一括処理しました。

2. すでにFMODにインポートしてあるアセットの代わりとして手順1の結果を入れて、通常設定を使ってボリュームを調整し、最後にゲームの中でその結果をテストしました。実は重要なサウンド、例えばキャラクタースキルなどは、手を加えませんでした。理由は、変更したサウンドと比較できる大事なインゲームサウンドをとっておくためで、自分の新しい設定の影響を確認しやすくするためです。この方法は、あとから行う微調整のときにも有効でした。

手順1は、さらに2段階に分け、まずカテゴリーごとにアセットを一括処理してから、1つ1つの特例に対応していきました。基本的な操作は次のように、Sound Forgeで行いました:

1. BGMの仕上げやバランス調整には、主にultrafunkのリバーブとEQを使い、ミッドレンジ周波数のための場所をあけました。なぜなら、メロディーセクションに中国の楽器を使ったのですが、これが主に800~2,000 Hzのミッドレンジだったからです。操作を行ったことで音楽がさらに後ろに追いやられ、リードとなる中国の楽器が特にそうでした。簡単に説明すると、すべてのBGMの音量を下げて、フィールドを広げ、その平均的なRMSが私たちが設定した目標値に従うようにして、短期RMS(クライマックス部分)は-14 dBを超えないようにしました。これでアンビエンス用のスペースが充分に空きました。

2. コンバットミュージック同士の差が、大きかったです。ほかのアセットと比べて変化が大きいアセットを選び、それらをEQで全体的に減衰させ、ラウドネスや周波数特性の大幅な変化を抑えました。次に、このグループ全体を一括処理して短いリバーブを追加して、EQを使ってミッドレンジと、ローからミッドと、さらに50 Hz未満も、下げました。そうすることでキャラクターのスキルやアクションのスペクトル的なスペースを確保できました。平均RMSは計画レベルあたりで維持して、12 kHz以上は減衰させましたが、アンビエンスは、細かい感触や空気のような質感を引き出すために例外としました。

3.キャラクタースキルはすべて、16 kHzで大きく減衰させて12 kHzで軽く減衰させることでシャープ感を抑え、150 Hzと500 Hzで、やや減衰させました。次にclanによってスキルが質的に異なるので(中訳注: Clan(一族)は中国のファンタジーゲームの単位で、西洋ゲームのrace(人種)に似ています)、各clanのスキルをEQでレンダリングして、clan同士のカラーの違いを最大限に表現できるようにしました。

4. アンビエンスに関しては、音そのものの特徴に基づきグループに分け(例えば「昼間の谷」グループ)、一括処理し、RMSや周波数特性の統一感をはかりました。次にリバーブで音場と深さを強調しました。風や雨を前面に出し(リバーブを減らす、またはリバーブなし)、それ以外をミックスの後ろに押し込みました(リバーブを増やし、EQ)。虫の音(セミ、コオロギ等)や、風など、一部のアセットを16 kHzで減衰させました。こういった音は4 kHzでさえカットダウンしました。ほかのサウンドとブレンドしやすくして、同時にソフトな質感を達成するためです。

5. ダイアログは、苦労しました。レコーディング中の声優とマイクの位置関係が、ゲーム中の位置関係と一致しない点は、従来のEQや圧縮では解消できませんでした。すべてのダイアログに対しヘビーなカラーレーションを適応するプラグインを使い、同じような特徴を共有するようにレンダリングしました。不一致の度合いをばっさり削減できますが、かなりの危険を伴い、最終手段として使いました。ダイアログの12 kHzは、もっと暖かいアナログ的な感触を目指して、頻繁にカットダウンしました。これで、中国の声優によくみられるパフォーマンス上の問題、例えば大きい呼吸音や息を細く吐く音など、正直、マイクの種類や配置にも関連する点を、消し去ることができました。

それでは、BGM(非コンバットミュージック)の一括処理を行う際のプラグイン構成の基本的な設定を紹介します:

このような一括処理や細かい調整には、以下の特徴があります。

1. まず、これらのプラグインはすべて、周波数のカラーレーションを行っています。第1の理由は、私が個人的に暖かくすることが好きだからで、第2の理由は、12 kHz以上を全般的に減衰させれば、高周波がゲーム中に蓄積され過ぎるのを防ぎ、もっと楽しめる音になるからです。アナログ指向のプラグインを使えば、とても上手に高周波を処理でき、くぐもった感じにもならず、温かみが増します。実はどのようなゲームプロジェクトでもカラーレーションプラグイン一式が必要で、ゲームタイトルに統一感と個性あるカラーを加えてくれます。このカラーが、ゲームのトーンになっていくのです。

2. 音の完全な帯域幅を維持する必要があるのは、実は稀なケースです!多くの音を、大体500~1,000 Hzで減衰させ、50~60 Hzより下も同じようにします。これら2種類の帯域幅では、音が互いに重なり合ってしまったり、急激に蓄積されたりしてしまうので(キャラクターのスーパースキルや爆発、そして衝突など、くぐもった感じの原因となる周波帯は、150 Hzと600 Hzの間に集中)、各サウンドの入り込む場所が、狭くなってしまうのです。アセット別、またはアセットカテゴリー別に作業するときにあえて空間を残すことで、初めて的を得たサウンドが達成され、ほかのサウンド用にスペースをとれます。

3. Ultrafunk Reverbは、個人的に特に思い入れのあるリバーブです。私が欲しかったのは、クリーンで、スペースが少なく、カラーレーションの軽いリバーブでした。理想的にはSonnox Reverbを選択したいところです。でも、高すぎました。そこで選んだのが、もうメンテされていない、この古いプラグインです。また、Ultrafunkは大好きなプラグインブランドの1つでもあって、ModulatorやDelayも好きで、モバイルゲームで非常に重宝しています(特に日本スタイルのクリーンな音に)。今回のプロジェクトでリバーブを使ったのは空間的な特徴をつかむエフェクトとしてではなく、音楽をほかのサウンドとブレンドしやすくするためです。映画や音楽制作の最終ミックスの段階でよくある手法です。リリース後のサウンドトラックの音楽のリバーブが、ゲーム音楽よりもドライであることが多いのも、このためです。

4. 一括処理が終わってから、そのアセットのRMSの状態を簡単に目で確認して、常に自分の耳で確かめるようにしました。理由は、2つのアセットのRMSが同じでも、ミックス内の配置の深さが違って聞こえることがあるからです。故意にそうする場合を除き、この状況は避けたいです。また、一括処理したアセットは、ほかの一括処理後のアセットと周波数特性が意外に異なることもあるので、この段階で対処しておきます。

こちらは、3Dアンビエンスのアセットカテゴリーに適用した一括処理の設定例です:

この段階では、まだ各サウンドの最終的な音質を達成することや、すべての問題を解決することが目的ではありません。90~95%のアセットで計画通りのラウドネスやスペクトルバランスを確実に達成することが唯一の目的です。うまくいけば、音がゲーム中に極端に大きくなったり小さくなったりしないはずです。これなんです!この結果があってこそ、いわゆるコアのゲームエクスペリエンスと、サウンドが、どのような関係にあるのかを感じ取ることができるのです。例えば、この処理を「エリア対象」とするならば、次の手順は「ポイント対象」となり、対象数が格段と増えます。私のやり方は、まず大きいポイントに対応してから、小さいポイントを探しだすことです。「大きいポイント」とはゲームプレイを通して決まる部分で、特にストーリーテリングに関与したり、主要シーンで切り替わったりするところです。

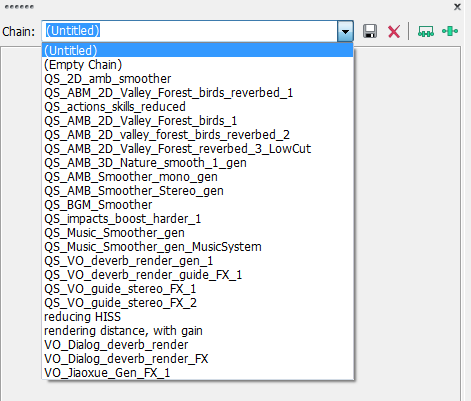

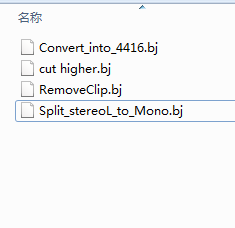

一括処理の大まかな手順:

1. 必要となるすべてのプラグイン構成を、Sound Forgeで作成します:

2. 各処理で使うプラグインを、それぞれ保存します(BJ拡張子のファイルとして)。

よく使われる一括処理のコンフィギュレーションです:

- これが一括処理のプリセットとなるので、天涯明月刀(Moonlight Blade)プロジェクトのドキュメンテーションに記載しておき、チームと共有します。こういった資料が、あとでコンテンツのインクリメンタル開発をするときに欠かせません。

- グッドプラクティスとして、プリセットをあなたのプロジェクトの個別プラグイン内に保存しておくようにしてください。

同時に、サウンドイベント間のボリュームの差を調整するのに、音響心理学の考えに基づき、0、-3 dB、-6 dB、-9 dBというように3 dBごとに試してみます。ビルドすると水のように味気ない音となりますが、これは予想したとおりです。音によっては、限度を超えたように聞こえるかもしれません。今までイベントのボリュームを微調整して整えて、サウンドスケープを細かく表現しましたが、ここで全体的なバランスを整えると押しつぶされてしまい、パターンが発生したのです。パターンは非常に重要で、ゲーマーは、ボリュームのレイヤー間のパターンを聞き取ることで、分かりやすく一貫性のあるエクスペリエンスを体験できます。ここで思い出すのが、アメリカのテレビドラマです。10シーズンもの長寿番組でも、ボリュームレイヤーと周波数特性の割合が一定に維持されます。MMOやモバイルゲームを刷新し続けるときも、テレビドラマと全く同じ考え方でいいのです!様々な音のカテゴリー間で、複層のボリュームシステムを使って、レイヤーのパターンを浮き彫りにしていくことが私の願いです。次に、各カテゴリーの細かいところまで確認しながら、聞いて大きすぎる音や小さすぎる音がないようにしたり、専用の周波数帯を確保したりします。基本的な考え方は同じで、引き続き小規模のサンプリングをして信用できる平均値をみつけてから、その調査結果に基づき一括処理します。ミックスのバランスをさらに整え、レイヤーを改善していくことが目的です。もう1つ、この手順を通して、ほかのメンバーに問題となりそうな箇所を事前に聞いてもらい、本当に直すべきところはどこか、確認できるのも助かります。アセットを個別に処理する前に、必ず全体のバランスを整えておきます。実は前述のとおりFMODの音のほとんどが -9 dBにも、-6 dBさえにもならないのですが、これは今回使用したFMODのバージョンで使う未知の減衰アルゴリズムが原因でした。私達が言えるのは、-6 dBからは、ボリューム減衰がバカみたいに早く進んでしまい、実に珍しい現象が起きたということです。ただ今回は時間が非常に限られていたため、実際にいつ起きているのかを確認するのは困難でした。

音をカテゴリーごとに一括処理する前に、それぞれのカテゴリーの中からランダムに、それなりの数のデータセットをサンプリングして、プラグイン構成やレンダリング設定を決めるための、ほどよい中間地点を探しました。これで、すべての蓄積されたコンテンツを適用するコンフィギュレーションも、確保できます。経験がモノを言う作業で、知恵熱が出そうでした。一番肝心なのがQAで、RMSラウドネステストと、リスニングテストの組み合わせます。特に注意してほしいのですが、この作業を始める前に、例えハリウッドのベテランでも「準備運動」をしておくべきです。例えば、普段から聞きなれている音楽や映画のサウンドトラックを聞くとか、前日の作業内容に関係することでもいいのですが、とにかく、自分の耳による判断能力を、毎日同じ水準に維持することが大事です。私もラウドネスやスペクトルのバランスを調整するときに、一部の作業でカラーレーションがほかより多く必要となると分かれば、自分で強制的にその日のうちに終了させるようにしました。聴力による自分の判断能力を一定に保つには、周波数特性、深さ、ステレオ幅、カラーなどに関係する決断が、自分の感情や体調に絶対に影響されないようにする必要があります。聴覚による判断能力を一定に保つには時間がとてもかかり、厳しい訓練も必要です。ここで簡単な例を紹介します。品質の高いサウンドライブラリを適当に選んでください。どんなに大きくても、その中にあるアセットの、基本的な部分であるラウドネスや、深さ、ステレオ幅、スペクトルカラーさえも、一貫性があります。つまり、研ぎ澄まされたモニタリング習慣、安定して明確なテイスト、それなりのモニタリング機器、そしてプラグインを確実に把握していることも、すべてあなたの判断能力に影響します。業界でフィールドレコーディングが推奨されるのもこのためで、プロジェクトをよくするという意味だけでなく、ポストプロダクションや最終仕上げの作業が、効果的な耳の訓練にもなります。

ダイアログのラウドネスと深さを処理する際に、昔ながらの問題とはいえ、困った事態に遭遇しました。状況によって、ダイアログの深さを変化させようと計画しましたが、それにはアセットの事前レンダリングが必要です。例えばメインクエストのシナリオタイプBでは、ダイアログをシーンと合体させ、一部は事前レンダリングしたリバーブも付けることになっていました。フルバンドのアセットはなく、ナレーションや特別なダイアログはまるで顔面直撃のフルバンドのプレゼンテーションのようにした一方で、マウスクリックのUIボイスは、プレゼンスをやや改善して、クオリティを薄くして、多くの周波帯を減衰させ深さを2メートル未満にしました。そうすると、シネマティックなレイヤは、もっとドラマティックで明快なスタイルで表現されます。ただ、ファイルの命名規則やキャラクターダイアログのカテゴリー分けがすでに決まっていたため、私たちがアセットをカテゴリー別に簡単に抽出することは、不可能でした。ダイアログはあまりにも大きすぎて、最も不利な状況でした。最終的にはやむを得ず、すべてのダイアログを全体的に事前レンダリングしました。同じ問題が、アクションやスキルのサウンドエフェクトでも起きました。コンソールの世界でダイアログアセットの名前は長いのが当たり前で、レコーディングのバッチインデックスがファイル名に含まれるケースもあるくらいです。これにローカリゼーションが加わり、コンソールゲームがさらに複雑になります。ビデオゲームのバランス調整やラウドネスコントロールは、詳細な計画を伴い、システム化されたプロジェクトとなることが多い理由が、ここにあります。ファイル構成、命名規則、各種機能、そしてインプリメンテーションまで、全体を考慮する必要があります。

私がSound Forgeと一緒に使う主なプラグインを、ここで紹介します:

- Waves All(主に使ったのは、REQ 4、API560 EQ、API2500 compressor、Schopes 730、NR)

- Ultrafunk

- Steinberg Masterting Edition

アセットのラウドネスコントロールが発生する主な場面は:

- ミュージック: マスター(パブリッシュ準備完了の、単独で使えるマテリアル)と、インゲームアセット

- ダイアログ: レコーディング(マイク選定と配置、プリアンプ選定と設定、室内音響のコントロール)、ポストプロダクション(バランス、ノイズリダクション、カラーレーション)

- サウンドエフェクト: 生アセット、インテグレーション後のアセット(全体のバランス調整前)、後期アセット(全体のバランス調整後の最終バージョン)

- ゲーム中のシネマティックス: マスター(パブリッシュ準備完了の、単独で使えるマテリアル)と、インゲームアセット

- トレイラー、プロモーションソング: ハイレゾリューションバージョンと、インターネット用バージョン(ローレゾリューションフォーマットで、コンテンツプロバイダーと共同制作したもの)

エピローグ

Skywalker(スカイウォーカー)のスタジオを訪問した際に、プロデューサーやデザイナーたちにラウドネスについて聞いてみました。彼らは前述の手順に加え、同じIP(知的財産)でもメディアフォーマットが違えば、かなり異なった対応をしていました。例えば、アメリカで、スターウォーズの劇場版はTHXに対応していますが、ホームシアター版はTHX、DTS、Dolby AC-3、そしてDolby Stereoに対応しています。これらのフォーマットに加えてトレイラーは、Vimeo、YouTube、QuickTimeなどその他のデジタルフォーマットに対応し、さらに場合によってiPhoneやiTunesも含まれます。彼らは普通、再生媒体によってラウドネスやダイナミック性をもう一度カリブレーションするほか、ファイナルミックスも違うバージョンを使うことがあり、同じミックスをポストプロセスに再利用することはありません。こうすることで、それぞれの媒体で最良の聴覚エクスペリエンスを、確実に配信できます。EAやUbisoftなどのゲーミング大手も、映画業界を真似たアプローチを採用し出しました。トレイラーやシネマティックスは、専用チームがプロデュースすることが多いです。複数のチームが関わる中、一貫したラウドネスやダイナミックな周波数特性を確実に維持するのは、実に困難です。例えば、スタッフ研修、ワークフロー、技術規格の教育、ハードウェアやソフトウェアなど統一されたツールセットなど、すべて非常に重要な要素です。

さらに、プロジェクトの最初の段階で、音の基本的なカテゴリーに関する情報を文書化して、アセットサイズ、解像度、プレイバック、ロード、インテグレーションなどについて、カテゴリーごとに指定しておきます。アセットの標準的な周波数特性やダイナミック性、収録方法、ポストプロダクション、一括処理、命名規則などを、カテゴリーごとに明記します。プロダクションチームやコンテンツプロバイダーたちと検討する中で、特にプロジェクトの最初の段階では、方針や要件だけでなく、それなりの技術的な話もするべきです。

以上はすべて、まだ議論の余地がありますし、読者の判断で応用してもらっても結構です。記載内容に間違いがあると思えば、気軽にコメントしてください。ご意見をお待ちしています!

コメント