このブログで検討する「ラウドネス」とは、都市の騒音を測定するラウドネスや、音圧測定器(SPLメーター)に表示されるラウドネスとは異なります。SPLメーターでは、音圧を測定します。音圧は気圧の指標で、真の気圧よりやや高いものです。測定方法も、ここで取り上げるラウドネスとは全く違います。ラウドネスは確かに電力という切り口で測れますが、それでは私たちが認識する音の大きさを表せません。実務上、ラウドネスは間違いなく主観的なもので、音響心理学が関係します。ただ、感情的な要素や心理的な要素以外にも、音を大きい、小さいと感じる決め手となるパターンが存在します。主に、以下のとおりです:

- ADSR

- 長さとリバーブ

- 周波数と周波数特性

- リズムと動き

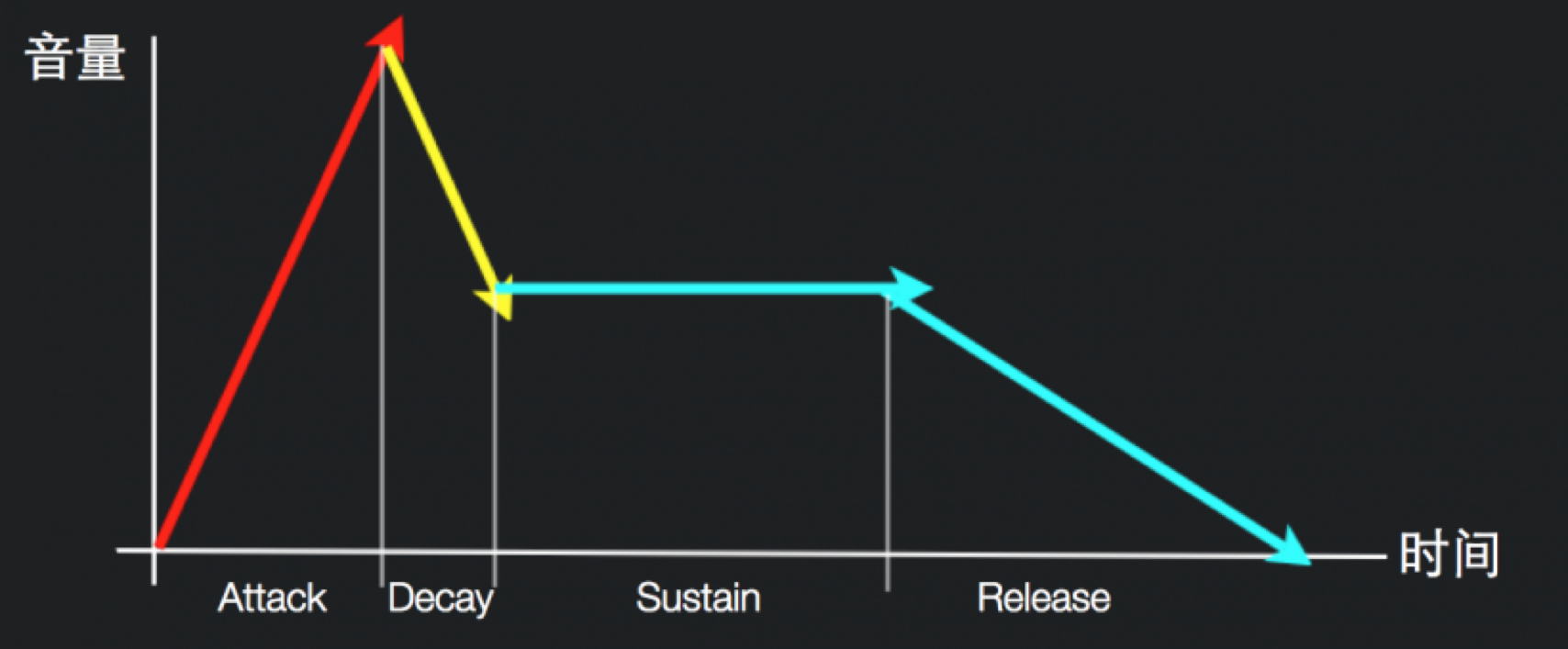

ADSR = Attack, Decay, Sustain, Release

ADSRは、別名エンベロープと言います。自然音の発生から終了までのライフサイクルを表しています。これらの4つのフェーズは、時間で表現され、一般的に使われる単位はms(ミリ秒)です。アタック(Attack)が小さければ小さいほど、ラウドネスが大きくなります。例えば打楽器のアタックは最短で15ミリ秒ほどです。弦楽器(一般的にアタックが50ミリ秒以上)と合わせると、ボリュームが同じでも、音が大きく聞こえ、場合によっては非常に大きく聞こえます。また、ガンショットはアタックが10ミリ秒以下です。打楽器よりもさらに大きく聞こえます。つまりラウドネスの問題は、アセットのアタック時間を調節するだけで解決できることがあります。

長さとリバーブ

一般的に、音の長さを決めるのは、ディケイ(Decay)、サステイン(Sustain)、そしてリリース(Release)にかかる時間です。ディケイが長ければ長いほど、音の大きい部分の長さが長くなります。つまり、もっと大きく聞こえます。同様に、サステインが長ければ、音がもっと大きく聞こえます。でも、この長さは固定値ではありません!主に、人間の本能の1つ、聴覚的な適応能力によって変化します。例えば、会社に着いた瞬間は空調の音が聞こえて、とてもうるさく感じるのに、数分が経ち、またはほかのことが気になると、音に慣れてしまい、もう気にならなくなります(やる気がなくなる次のタイミングまで)。このような聴覚の適応能力は、選択的聴取の一例です。単純に言えば、聴覚的な注意力を刺激するのに、真新しさや変化を継続的に与えなければならないのです!それでもサウンドデザイナーは時には、本能に抵抗する必要があります。

ここでいうリリースは遅延とは異なり、音が伝播し続けてから徐々に消えるまでにかかる時間のことです。リバーブと深く関係することがよくあります。興味深いことに、私たちはリリースがサウンドエフェクトのラウドネスにどれだけ影響するのかを忘れがちです。いわゆるリリース部分を聞き取れないこともあるかもしれません。例えば、爆発音の場合を考えます。この場合、本体が実はリリース部分で、爆発自体が10ミリ秒で終わってしまうからです。実際、「パリッとしてパンチの効いた音が欲しい」というとき、それを達成するのにリリースが肝心なのです!例えば多くの場合、パンチの効いた音が欲しくても、ほかの音を隠すほど大きくては困ります。そのときは、最初にリリースの長さを調整して、自然な流れで音が消滅してしまわないようにします。特にサウンドトラックの作業では重要となってきます。スピード感のあるコンバットの場面で、特定のサウンドエフェクトを狙っていない限り、衣擦れ音をやさしくフェードアウトさせるのはアマチュアのやり方です。そのようなリリースでは、音がダラダラと長引いて聞こえてしまいます。連続する爆発音や衝突音で使うレイヤー方式を思い出してください。個々のアセットレイヤーのリリース音量が小さく見えても、1レイヤ3dBほどのペースで急激に増加すれば、分別不能な混乱状態になってしまいます。ガンショット音でも同じです。逆に、芸術的な観点から、十分に長いテイルを設定する必要のある音もあります。その場合は、ディケイを早めてサステインも早くディケイするように設定すれば、リリースが長くても、ほかの音で簡単に隠せます。複数の音をレイヤリングするには相互のボリューム差を均一にする必要があるので、音同士で消し合ってしまうのを避けるために、リリースを適切な低音量で維持します。

一方リバーブで、音のテイルを長くできます。初期反射によって、ドライな音の上に重ねた音全体が、大きく聞こえます。必ずしも悪いことではありません!どちらの場合も、ラウドネスをコントロールするためにこの状況を利用します。例えば典型的な日本のゲームのUI音、特にPS3やPS4のシステムサウンドなどは、かなり静かですが、はっきりと聞き取れます。なぜ?理由は2つあり、まず普通はリバーブが長く、1~1.5秒ほどなので、このような非常に短いサウンドが延長され(小さく聞こえるのは、長さが短いから)、感じられるラウドネスが大きくなります。次に、適切なリバーブタイプ(BGMに適用するリバーブと比べ)を採用すれば、音が新しい、または不自然な、音場に配置されます。不自然さ、または真新しさが、あなたの耳を刺激し、音が大きくなったような印象を受けます。

音が長続きし、例えば60秒以上の音楽セグメントなどの場合は、ADSRで説明するのは不適切です。そこで新たな用語としてシェイプ(Shape)を使います。シェイプとは音波のピーク形状の輪郭のことです。この形状を変更すれば、音のラウドネスの展開を変えられます。シェイピングというアプローチで、シンセシスやエフェクトに広く使われています(今後、詳しく話します)。シェイピングは、私が音のリズムやラウドネスをコントロールしたい時によく使う方式で、特に最終段階の微調整などで活用します。シェイピングをしてもRMSは変わらず、ピーク部分の展開が変更されるだけで、重要でない間は音が継続して小さくなり、必要な時は少し音が大きくなります。聞く人の注意に働きかけることで、希望するラウドネスの変化を実現します。

興味があれば、ラウドネスの参考文献として、私が若い頃にAnDong教授と共同執筆した本、数字音频基础 を読んでみてください。

ラウドネスに関連する数学的な原理をいくつか紹介しているので、参考にしてください。

周波数

等ラウドネス曲線のことはすでに知っているでしょうから、その重要性については省略します。曲線から読み取れる基本的な現象は、アタックとしての周波数が、人間のラウドネス認識を左右するということです。それでも、私の観察や経験から言うと、周波数を使ってラウドネスをコントロールできることは、よく見過ごされています。例えばモバイルゲームは、携帯のスピーカーを通ると350Hzより下の周波数のコンテンツがすぐに消えてしまうのに、ほとんどのゲーマーはヘッドフォン無しでプレイしています。この場合、爆発音の低周波数を上げたとしても、クリッピングが発生したりほかの音が消し潰されてしまったりするだけで、音が全体的にくぐもって聞こえます。実際、誰もが経験することですが、爆発が大きければ大きいほど、音がくぐもって聞こえるような気がします。高周波はどこへ行った?ちゃんとあります。ただ低周波が、高周波をカバーしてしまっただけです!そこで鮮やかな音を維持したければ、高周波を上げると同時に、不要な低周波を下げなければなりません。これは、音楽のベースをミキシングするときによくあるシナリオです。ベースを重厚で安定した音にするには、低周波を大きくしても無駄です。もっと効果的なのは、高周波(4kHz以上)を調整することです。ただ、それだと全体のボリュームが大きくなってしまいます。では、どうすればいいのか?当然、中周波や低い中周波を減衰させればいいのです!中周波(1~2 kHz)によって、音がまるで近づいてきて大きくなったように聞こえることが多く、これによって高周波や低周波がある程度、隠れます。音楽ジャンルによっては、ここでいう低い中周波の代わりに、状況に合わせて低周波にできます。つまり、ボリュームやラウドネスを効果的に処理するには、ボリュームレベルをいじるのではなく、中周波 (1-2kHz) や低い中周波 (500Hz あたり) を削減すればいいのです。こうすればベースの高周波や低周波をあまり大きくしなくても、ベース音のハイやローの力を発揮できます。この時点で、ベースの52Hz以下は減衰させてしまい、ほかの楽器用に残しておくことも検討できます。まあ、ここまでくると、ミキシングの領域ですが。でも、サウンドデザイナーであれば必ず研究して習得する必要のある技術です。ミキシングは単にフェーダーを上下させることではなく、EQを使って、各楽器のラウドネス、深さ、空間的な課題などを解消することが主な役割です。目的によって違うEQを試す必要があり、世界中を探しても万能のEQプロセッサーは見つかりません。

次に、1 kHzと500 Hzにまつわるストーリーを、紹介します。多くの音で、激しい部分は大体500~1000Hzに集中し、もっとパワフルな音の場合は、これが250Hzあたりになります。もし音を大きく聞こえるようにしたくても、あまりうるさくしたくなければ、試しに1000Hzをカットしてみてください。まず簡単にテストします。周波数をずっと下まで下げて、その音にこのアプローチを使えるのかを確認してから、効果的であれば、徐々に上げて元に戻します。ちびちびと減衰させるような方法は、絶対に避けます。微調整をしながらの修正は、集中力に悪影響をおよぼし、最後にはわけが分からなくなってしまいます!パンチの効いた音(低周波)でありながら強い音(1000Hzあたり)であり、小さい音を隠してしまわないようにするには、まず500Hzを目標にし、250と500Hzの間あたりに、おさめます。

パワースペクトルという観点で、どの音にも主要な周波数帯があることを意識してください。この帯域をさわってしまうと、音のラウドネス全体が変わります。つまり、この周波数帯は重要で、それ以外は必要に応じて排除できます!例えば、500Hzはエレクトリック・アコースティック・ギターの音色に不可欠ですが、ギターがリズムだけのためなら?500Hzでカットしても、その音楽的な役割に影響はありません。では、カットオフしてしまえばいいのでは?実は楽曲ではよく、リズム用エレクトリック・アコースティック・ギターの500Hz以下をすべてカットしてしまいます。この話には重要なメッセージがあり、どんなアセットでも、ミックスの一部だということです。アセットのユニークな特性が、そのアセットの存在理由です(でなければ、不要なので)。その特性を維持しても修正してもいいのですが、必ず、その音の中で、全体に最も貢献している部分はキープして、それ以外は重要性があまりなく、必要があれば削除するというスタンスで進めます。何かをキープしたいときは、まず必要かどうか、自問自答してください。次に、重要でない周波数帯が、引き立たせるために有効かどうかを検討します。

それでは、おもしろい話をもう1つ。成人の多くは、可聴スペクトル領域が20 kHz未満です。私の場合、最近は18.5 kHzあたりですが、18 kHzのサイン波ですでに耳に鋭い痛みを感じます。また、ホワイトボードを爪でひっかく音は、ほとんどの人にとって非常に大きく不快な音ですが、SPLメーターで測定すると音量はさほど大きくありません。トランジェントは高いかもしれませんが、RMSは低いのです。

周波数特性の見方は、あなたのミキシングスキルや経験で大きく変わってきます。ミキシングするときに、まず作品の全体的な印象を一番大事にして、微調整する部分は、すべて全体像の一部としてとらえます。ゲームでも、映画やテレビ番組でも、楽曲の場合も、音には要素ごとの役割があり、その配置場所や、どれだけ目立たせるかも、決まります。

リズムと動き

私たちが耳にする音の多くは複雑で、動きがあります。音のリズムや動きが、私たちが感じる音のラウドネスに影響します。例えば多くの映画で、壮絶な爆発の場面(一般的にパノラマ撮影)、その直前に20~80ミリ秒ほどの短いギャップがあります。音楽もダイアログも、唐突に止まります。そうすると、続く爆発音が非常に大きく感じられます。ところが、このアセットを抽出してテストしてみると、ボリュームレベルが、そして実にRMSでさえも、受け取った印象よりも大分低いことに気付きます。

この効果を説明する原理は非常にシンプルで、それはダイナミック性というものです。音響におけるダイナミック性の定義は、ボリュームの違いです。「ピークレベル間の差」として単純化することもできますが、ラウドネス測定が成熟してきた現在、ダイナミック性を表すのに、ラウドネスの差分の指標としてLRAが使われます。このアプローチは広く使われ、特に巨大な爆発や、縮小する音や増大する音の入ったスティンガーに使われるほか、連続する衝突音の激しさを抑えたいときにも使えます。時々、連続する音のピークは高くなくても、大きい音のような錯覚を誘引することができます。隣り合わせたセグメントのピーク間の差や、ギャップの長さを、うまくコントロールすることが大事です。多くのハリウッド映画で、このギャップが1~2秒間も長引くことがあります。このドラマチックな一時停止こそ、素晴らしい聴覚的インパクトを引き起こします。

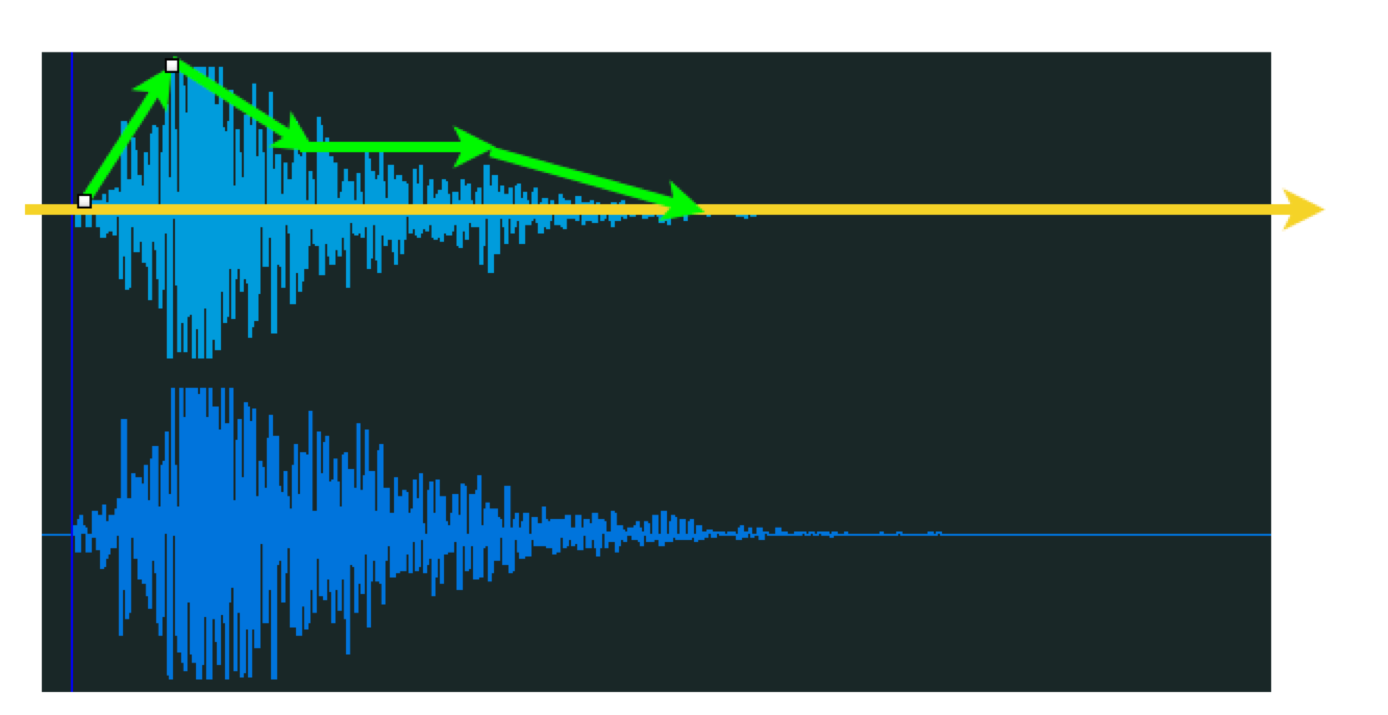

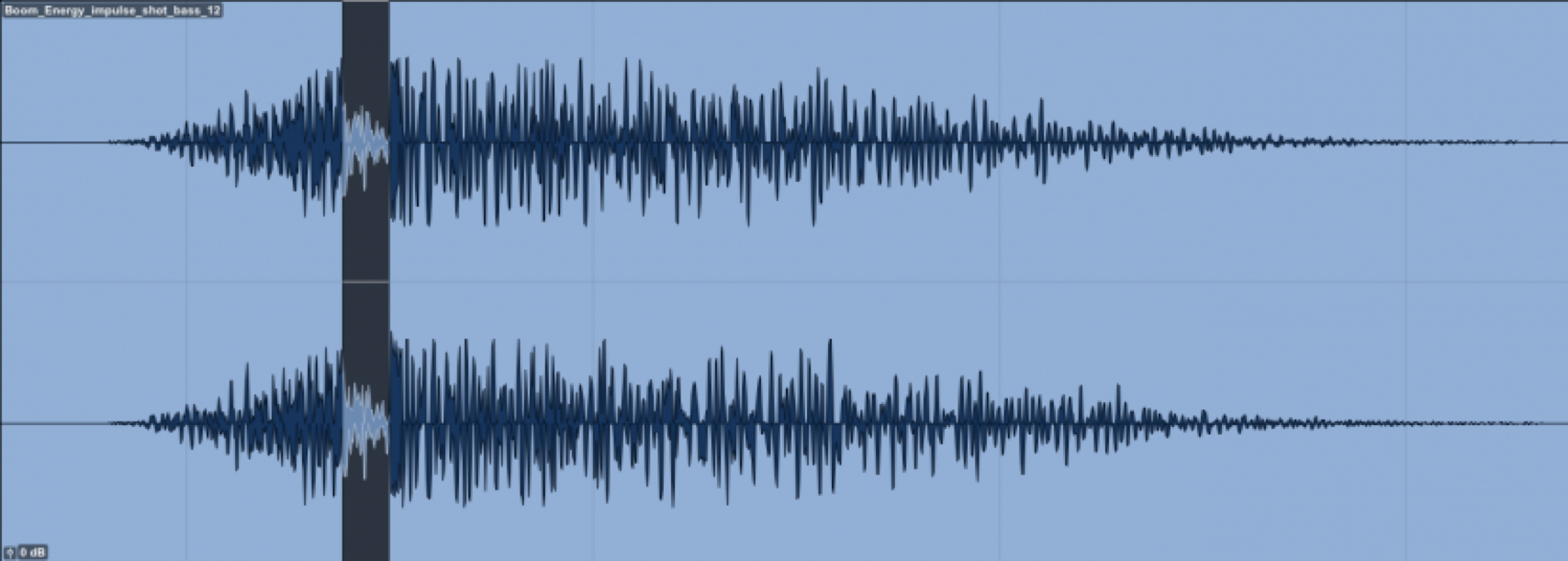

連続する音の主要な周波数帯の違いによる影響は、とても目立ちます。ドラムビートで言うならば、基本的な要素はベースドラムとスネアドラムで、それぞれの主な周波数帯を比べると、大きな開きがあります。そのままのピーク値や、RMSでも、これらを適切に並べれば、十分に大きなラウドネスを達成できます。ドラムンベースやヒップホップが、その典型例です。ここに2つのサンプルを用意しましたが、それぞれの後半に同じスティンガーが入り、前半のリバース音には、全く違う周波数帯が使われています。このように、結果の違いは簡単に聞き取れます:

上図のハイライトされた暗い部分が、約100ミリ秒のギャップです。

スティンガーだけのときの、ラウドネスの違いをみてください。

次は、スティンガーの前にイントロとギャップが入った例です。

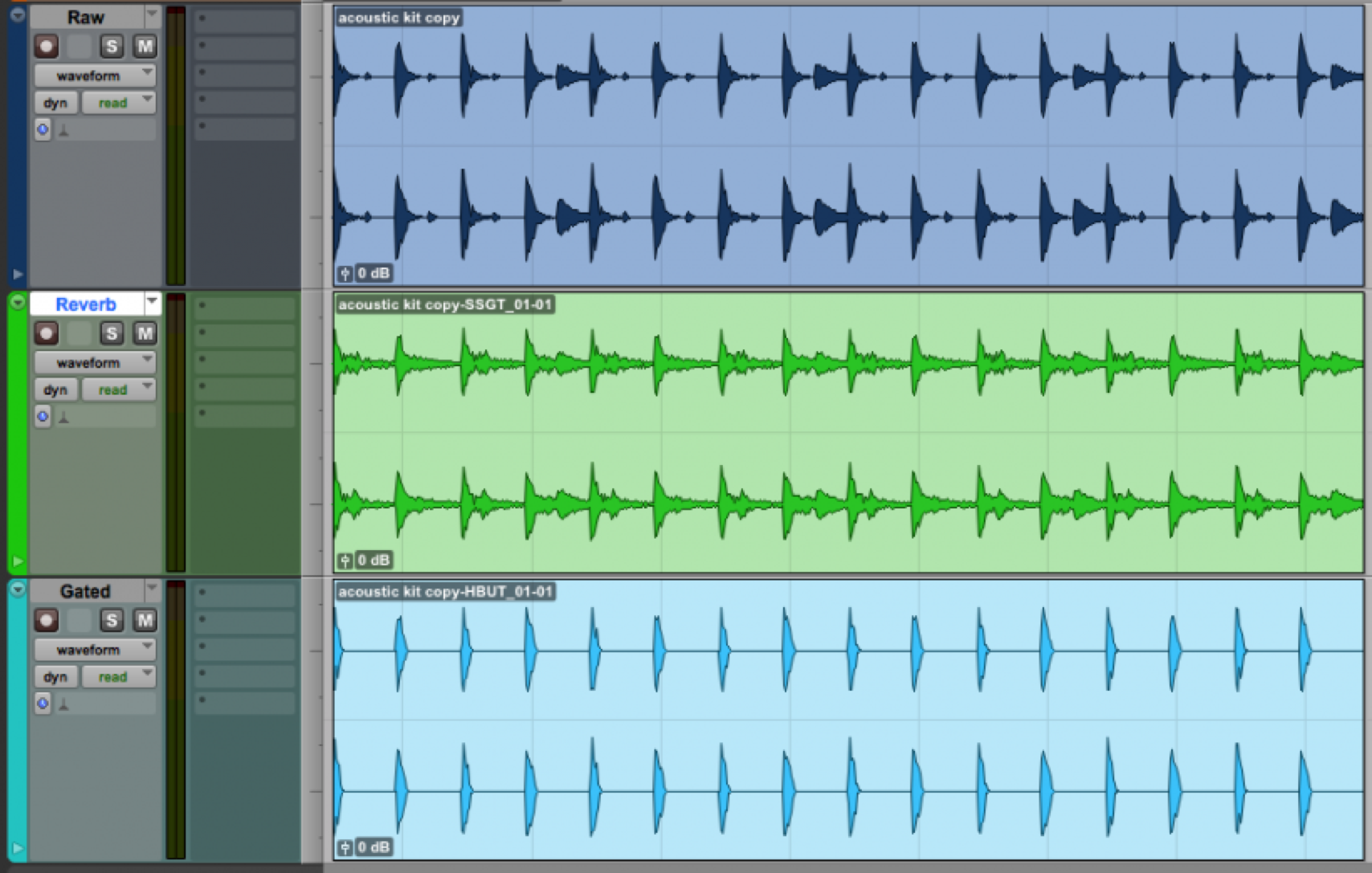

これらのビートを聞いてみてください: [1列目がオリジナル音です]

A. 2列目は、長いリバーブがあり、明らかに音色がつながっています。

B. 3列目は、リバーブがないため、はっきりとしたつながりはなく、ゲーティングで区切られています。

リバーブの、ラウドネスに対する影響の仕方を私たちは理解していますが、リバーブはADSRに影響するだけでなく、特定の周波数帯を増幅させるので、聴覚的な体験を左右することもよく認識しておく必要があります。複合的な影響が発生します。サウンドデザイナーは、これらの要素を分析して活用することができます。特に、音が一時的に離れ離れになると、聴覚的な連続性が中断され、聞く人はラウドネスを正確に判断することが難しくなり、聞こえ方も途切れてしまいます。

これらは基本的には音楽のビートですが、打楽器も多くのサウンドエフェクトと同様に、通常はノイズとして分類されます。このため打楽器のパフォーマンスに対するアプローチとして音色を作成してミキシングすることは、効果音の作成に似ています。ところが、リズムや動きや周波数の違いなどから生まれる知覚的なダイナミック性は、一般的に効果音よりも目立ちます。別の例を考えてみます。ドラマーが不安定なテンポを演奏したり、不安定なダイナミック性で演奏したりすると、音が突発的に聞こえたり、合っていない音が非常に大きく聞こえたりするかもしれません。ラウドネスとは、実に主観的で、経験的で、限定的であることを証明する現象です。

これ以外にも、様々な状況や考え方があります。あなたがどれだけ音を理解し、想像力があり、そして新しいものにチャレンジする気があるかによって、あなたの使うアプローチが決まります。正しい答えがあるわけでもなく、あるのは良い選択と、それよりもさらにいい選択だけです。音楽でも、映画のサウンドトラックでもいいので、とにかくマルチトラックミキシングを練習することをお勧めします。長い目で見れば、これで沢山の技や経験を身に付けることができます。

以上はすべて、あなたの見解次第で議論の余地があると考えています。記載内容に間違いがあれば、教えてください。ご意見をお待ちしています!

コメント